|

|

Künstliche Intelligenz am Edge und Deep Learning |

|

|

Höhere Auflösungen treiben Innovationen voran |

|

|

Ereignisgesteuerte Kameratechnologie |

|

|

Kostengünstige SWIR-Bildgebung |

Die rasanten Fortschritte in der Sensor- und Automatisierungstechnik bringen erhebliche Veränderungen in der industriellen Bildverarbeitung mit sich. Durch künstliche Intelligenz (KI), Bildverarbeitungssoftware und neuartige Hardwarearchitekturen werden Branchen wie Fertigung, Gesundheitswesen, autonome Fahrzeuge und Robotik optimiert. Diese Änderungen führen bei einer Vielzahl von Anwendungen in allen Branchen zu Produktivitätssteigerungen, Kosteneinsparungen und besseren Entscheidungsgrundlagen.

Edge-KI oder Edge Learning ist eine besondere Form der künstlichen Intelligenz, bei der Algorithmen und neuronale Netze für Deep Learning direkt mit Computergeräten am Rande eines Netzwerks verwendet werden. Die Datenverarbeitung erfolgt in erster Linie auf der Kamera, und die Informationen werden direkt in die verbundene Cloud exportiert. Diese Systeme haben den Vorteil, dass sie sich wiederholende Prozesse und Abläufe automatisieren und so den Stromverbrauch, die Netzwerklatenz und die Gesamteffizienz von Anwendungen optimieren.

Künstliche Intelligenz ist an und für sich kein brandneuer Trend. Deep-Learning-Modelle für neuronale Netze werden in immer kürzeren Abständen auf Anwendungen angewandt, wobei unglaubliche Ergebnisse erzielt werden. Was die LUCID Vision Labs™ SENSAiZ intelligente CMOS-Kamera auszeichnet, ist die einzigartige Kombination aus hoher Auflösung und KI. Frühere Versionen der KI für die industrielle Bildverarbeitung nutzten Sensoren mit etwas geringerer Auflösung, die das Bild mit VGA-Auflösung abtasteten.

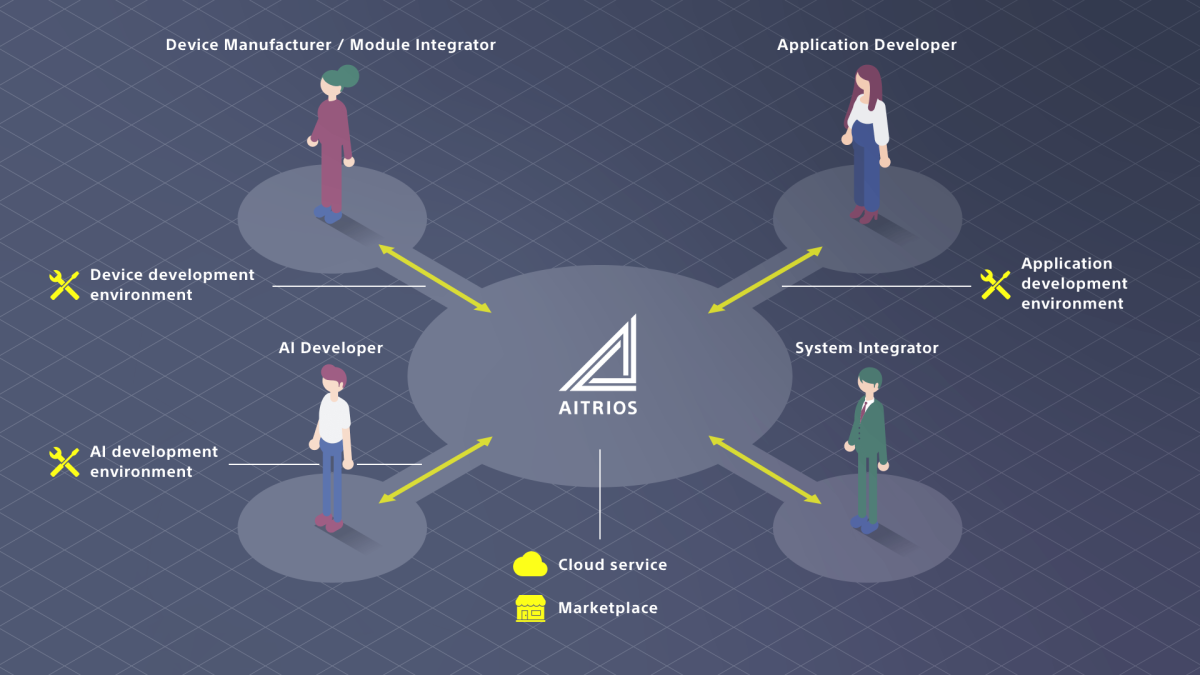

Lucid Vision Labs hat sich mit Sony zusammengetan, um den 12,33-Megapixel-IMX500-Kamerasensor mit der AITRIOS-Plattform für Deep Learning zu kombinieren. Zusammen ermöglichen diese Technologien den Endnutzern die Entwicklung von KI-Tools zur Steigerung der Anwendungseffizienz, zur Einsparung von Ressourcen wie Strom und Bandbreite und zur Erforschung neuer Anwendungsbereiche. Darüber hinaus gibt es andere Kamerahersteller und Softwarepakete, die ähnliche Ziele erreichen, darunter einige Kameramodelle von Cognex in Kombination mit dem Vidi AI-Paket.

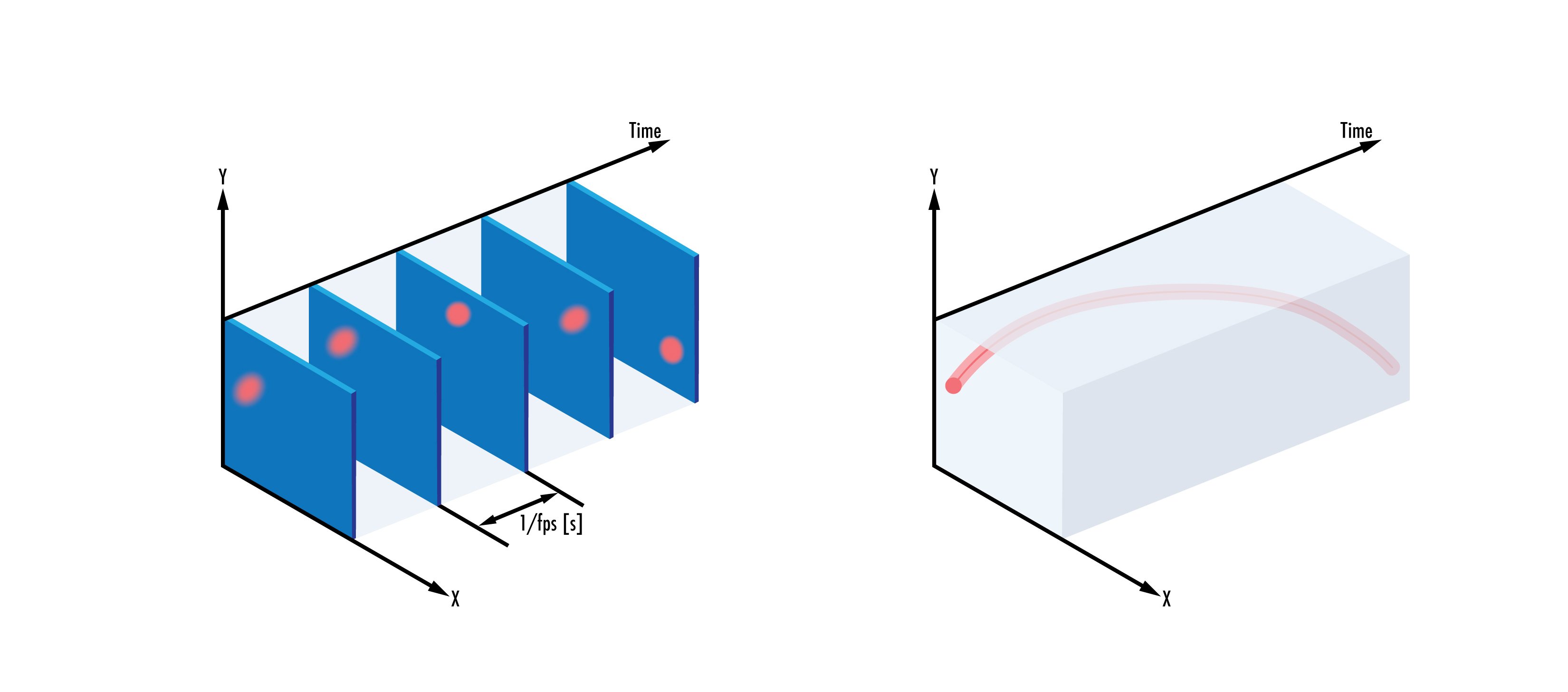

Die ereignisbasierte industrielle Bildverarbeitung, auch bekannt als neuromorphes Sehen, ist eine Bildgebungsmethode, bei der der Kamerasensor, manchmal auch als dynamischer Bildsensor (DVS) bezeichnet, eine kontinuierliche Aufzeichnung der Belichtungsintensität vornimmt, die nicht durch einen Shutter behindert wird. Auf der Ebene der einzelnen Pixel werden Intensitätsänderungen asynchron und parallel aufgezeichnet, ähnlich wie bei neuronalen Netzen, um die begrenzten Rechenressourcen an Bord zu schonen.

Die ereignisbasierte Bildverarbeitung zeichnet sich durch eine geringe Latenz (in der Größenordnung von Mikrosekunden) und eine hohe zeitliche Auflösung aus, so dass die Bildrate vollständig entfällt, da nur die wesentlichen Bewegungsinformationen erfasst werden. Durch die Eliminierung der Bildrate haben die Bilder zudem eine hohe dynamische Auflösung und geringe Bewegungsunschärfe bei geringem Stromverbrauch der Kamera. Diese Art der Bildverarbeitung hat Potenzial für die Robotik, autonome Fahrzeuge und viele andere Industriebereiche.

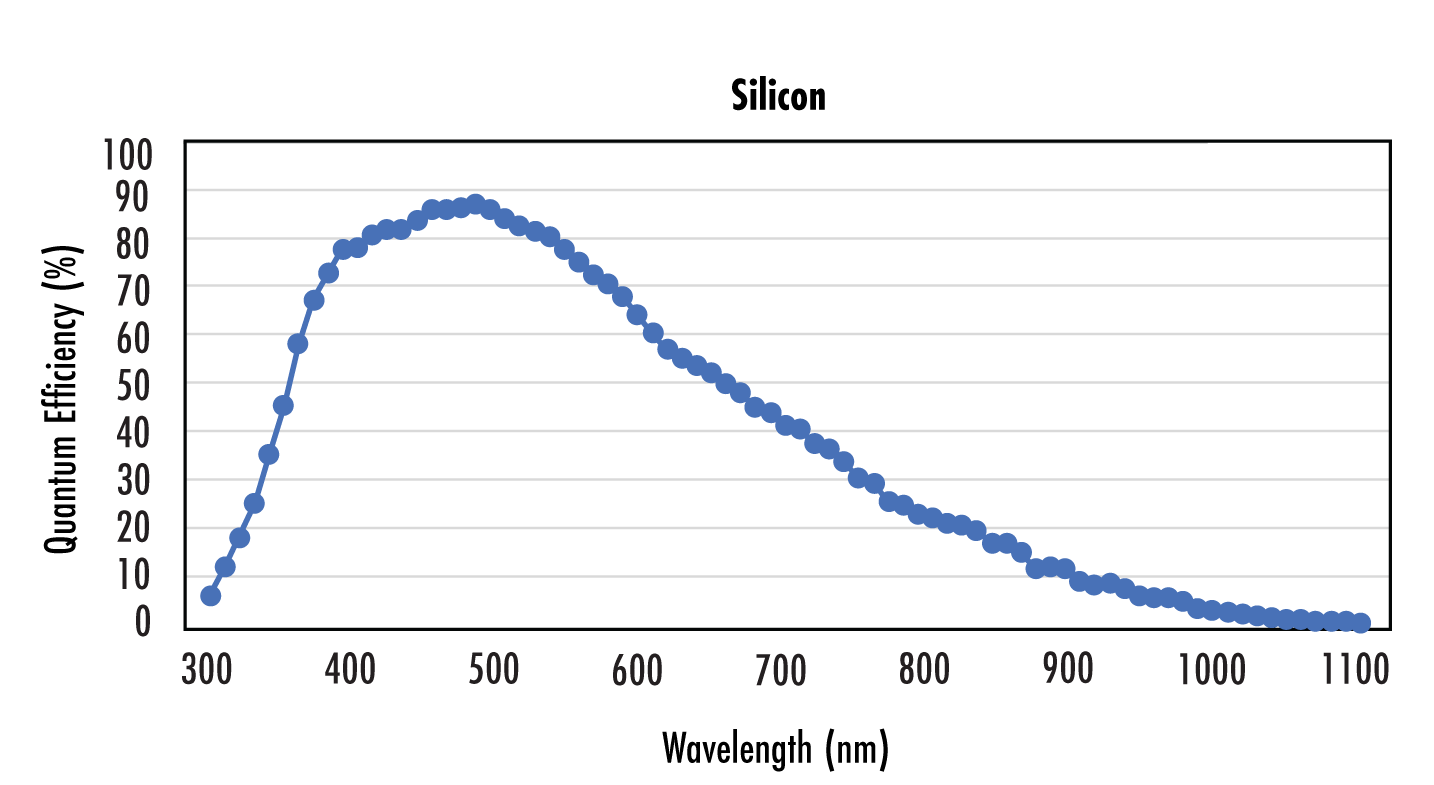

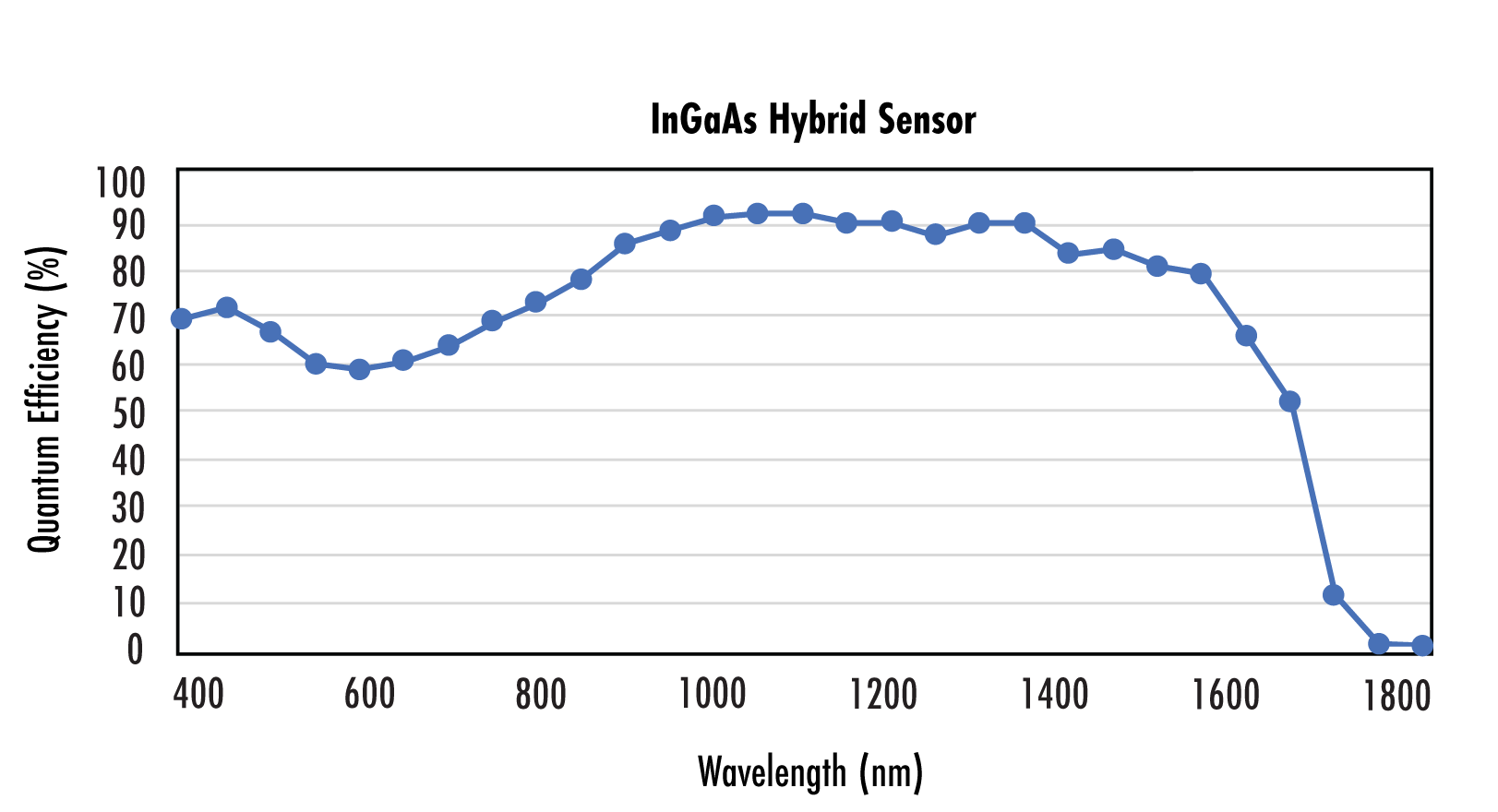

Bei der Bildgebung im kurzwelligen Infrarot (SWIR) wird typischerweise Licht im Wellenbereich zwischen 0,9 und 1,7 µm verwendet, es kann aber auch Licht von 0,7 bis 2,5 µm zum Einsatz kommen. Da die SWIR-Wellenlängen außerhalb des sichtbaren Spektrums liegen und typische Siliziumsensoren für sichtbares Licht nur bis etwa zum nahen Infrarotspektrum (zwischen 650 nm und 1 µm) empfindlich sind, werden SWIR-Sensoren aus anderen Materialien wie Indiumgalliumarsenid (InGaAs) und Indiumphosphid (InP) hergestellt. Bislang waren diese Sensoren sehr schwierig herzustellen, was zu hohen Preisen führte. Die Fortschritte bei der Herstellung von SWIR-Sensoren in den letzten Jahren haben jedoch die Herstellungseffizienz und damit die Erschwinglichkeit erheblich verbessert.

Die bisher hohen Preise für SWIR-Kameras stellten eine Zugangsbarriere für neue Anwender dar. Daher beschränken sich die derzeitigen Anwendungen dieser Technologie auf die Überwachung von Landwirtschaft und Umwelt, die Qualitätskontrolle für industrielle Anwendungen wie der Pharmazie und die Astronomie. Dank des günstigeren Preisniveaus kommen Endnutzer in die Lage, neue Anwendungsbereiche zu erkunden, zum Beispiel die Restaurierung von Kunstwerken und vieles mehr (Abbildung 5).

Rollen Sie über die Graphik, um das SWIR-Bild zu sehen

weitere regionale Telefonnummern

ANGEBOTSTOOL

Geben Sie zum Starten die Produktnummer ein.

Copyright 2023 | Edmund Optics, Ltd Unit 1, Opus Avenue, Nether Poppleton, York, YO26 6BL, UK

DATENSCHUTZRICHTLINIE | COOKIE POLICY | AGB | AGB FÜR B2C | IMPRESSUM | BARRIEREFREIHEIT

Die Edmund Optics GmbH Deutschland fungiert als Handelsvermittler für die Edmund Optics BV in den Niederlanden.

Vertragspartner ist Edmund Optics BV in den Niederlanden.

This content may include material that has been generated or modified using artificial intelligence (AI).

The FUTURE Depends On Optics®