Bildgebungselektronik 101: Digitalkamera-Einstellungen für bessere Bilder

Digitalkameras bieten dem Benutzer im Vergleich zu Analogkameras eine höhere Flexibilität bei der Anpassung der Kameraeinstellungen über die Bilderfassungssoftware. In manchen Fällen können die Einstellungen in Analogkameras über die Hardware angepasst werden, beispielsweise über DIP-Schalter oder RS-232-Anschlüsse. Trotzdem trägt die Flexibilität, die Kameraeinstellungen einfach per Software zu ändern, erheblich zu einer besseren Bildqualität, schnelleren Abläufen und mehr Kontrast bei – Faktoren, die darüber entscheiden können, ob ein Fehler in einer Inspektionsaufgabe erkannt wird oder übersehen wird. Viele Digitalkameras besitzen integrierte, programmierbare Logik-Gatter-Anordnungen (field programmable gate arrays - FPGAs) für die digitale Signalverarbeitung und die Kamerafunktionen. FPGAs führen die Berechnungen für viele digitale Kamerafunktionen sowie Zusatzfunktionen aus, beispielsweise die Farbinterpolation bei Mosaik-Filtern und einfache Bildbearbeitungsaufgaben (bei Smart-Kameras). Zur Kamera-Firmware gehören die FPGA und der integrierte Speicher; gelegentlich sind Firmwareupdates für Kameras verfügbar, welche die Funktionen ergänzen und verbessern. Der integrierte Speicher in Digitalkameras dient zur Speicherung der Einstellungen und von Lookup-Tabellen, als Puffer bei hohen Transferraten und zur Vernetzung mehrerer Kameras mit Ethernet Switches. Die wichtigsten Digitalkameraeinstellungen sind der Verstärkungsfaktor (Gain), Gammakorrektur, begrenztes Auslesen des Sensors, Binning/Subsampling, Pixeltakt, Offset und Triggereinstellungen. Wer die Bedeutung dieser Grundeinstellungen kennt, kann bei den meisten Anwendungen optimale Ergebnisse zu erzielen.

SIGNALVERSTÄRKUNG (GAIN)

Die Einstellung des Gains einer Digitalkamera legt fest, wie das Signal vom Kamerasensor verstärkt wird. Dabei wird das gesamte Signal verstärkt, das heißt, auch das Hintergrundrauschen. Bei den meisten Kameras wird der Verstärkungsfaktor automatisch eingestellt ("Autogain", abgekürzt AGC), manche Modelle erlauben allerdings auch die manuelle Einstellung oder eine Abschaltung der Automatik.

Die Verstärkung kann vor oder nach dem Analog-Digital-Wandler (ADC) geschehen. Erfolgt die Anhebung allerdings nach dem A/D-Wandler, dann wird keine echte Verstärkung erreicht, sondern nur eine digitale Anhebung. Bei einer digitalen Anhebung des Gain gleicht die Software die Digitalwerte mit anderen Werten in einer Tabelle ab, sodass Informationen verloren gehen.

Eine höhere Verstärkung vor dem Analog-Digital-Wandler kann dabei helfen, die Pixeltiefe der Kamera auch bei schlechten Lichtverhältnissen voll auszunutzen. Allerdings ist es in fast allen Fällen vorteilhafter, die Beleuchtung zu verbessern, statt mit höherem Gain zu arbeiten. Mit der Einstellung des Gain kann auch sichergestellt werden, dass die einzelnen Signale von Sensoren mit mehreren Datenausgängen gut aufeinander abgestimmt sind. Eine ausführliche Diskussion über Sensoren mit mehreren Ausgängen oder "Multi-Tap-Sensoren", finden Sie in Bildgebungselektronik 101: Kameraauflösung und ihr Zusammenhang mit der Bildqualität. Allgemein sollte der Gain nur geändert werden, wenn über die Belichtungseinstellungen keine Verbesserung mehr erreicht werden kann und die Belichtungszeit für die vorgegebene Bildrate bereits maximal ist. Welche Verbesserungen mit unterschiedlicher Verstärkung bei einer Aufnahme erzielt werden können, sehen Sie in den Abbildungen 1a, 1b, 2a und 2b.

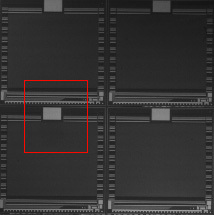

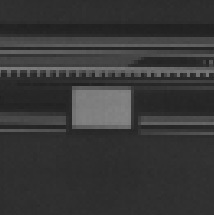

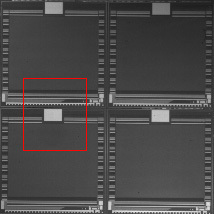

Abb.1a: Aufnahme ohne Verstärkung (AGC = 0), Gamma = 1, Pixeltakt 8 MHz, Belichtungszeit 0,2 ms.

Abb.1b: Nahaufnahme mit AGC = 0, Gamma = 1, Pixeltakt 8 MHz und Belichtungszeit 0,2 ms.

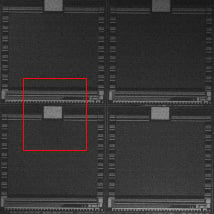

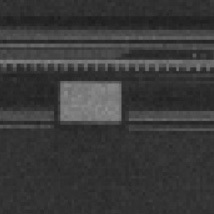

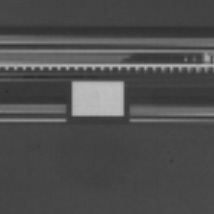

Abb.2a: Aufnahme mit hoher Verstärkung (AGC = 100), Gamma = 1, Pixeltakt 8 MHz und Belichtung 3,4 ms.

Abb.2b: Nahaufnahme mit Verstärkung AGC = 100, Gamma = 1, Pixeltakt 8 MHz, Belichtungszeit 3,4 ms.

GAMMA

Die Gamma-Einstellung legt fest, wie die Digitalkamera die Grauskala auf dem Bild reproduziert. Ein Bild mit Gamma = 1 (Abb. 3a - 3b) bedeutet, dass der Kamerasensor die aufgenommene Grauskala exakt reproduziert (lineare Kennlinie). Eine Gammawerteinstellung, die deutlich größer ist als "1", ergibt ein Schwarz-Weiß-Silhouettenbild (Abb. 4a – 4b). In Abbildung 4b ist der schlechtere Kontrast im Vergleich zu Abbildung 3b deutlich zu erkennen. Der Gamma-Wert kann als Möglichkeit betrachtet werden, eine Seite des Dynamikbereichs, also hell oder dunkel, zu strecken. Diese Regelung wird oft in der Signalverarbeitung verwendet, um ein besseres Signal-Rausch-Verhältnis (SNR) zu erzielen.

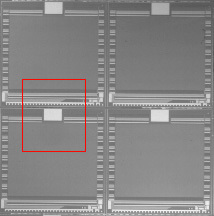

Abb.3a: Aufnahme mit linearer Kennlinie (Gamma = 1), Pixeltakt 10 MHz, Belichtungszeit 5 ms.

Abb.3b: Nahaufnahme mit Gamma = 1, Pixeltakt 10 MHz und Belichtungszeit 5 ms.

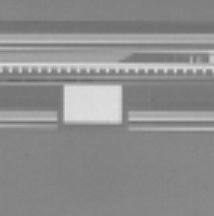

Abb.4a: Aufnahme mit Gamma = 2, Pixeltakt 10 MHz und Belichtungszeit 5 ms.

Abb.4b: Nahaufnahme des Bildes mit Gamma = 2, Pixeltakt 10 MHz, Belichtungszeit 5 ms.e

AUSGEWÄHLTER BILDFELDBEREICH - AREA OF INTEREST

"Area of Interest" ist eine Einstellung der Digitalkamera, die es ermöglicht, nur einen Teil des Kamerasensor-Arrays auszulesen. Diese Einstellung kann software- oder hardwareseitig passieren. Der Zweck ist die Verringerung des Bildfeldes (FOV) oder der Auflösung auf den niedrigsten erforderlichen Wert, um die zu übertragenden Bilddaten zu verringern und damit die Bildwiederholfrequenz zu erhöhen. Objektseitig bleibt für diesen Teilbereich die volle Auflösung erhalten, das heißt die Nyquist-Frequenz und die Raumabtastfrequenz ändern sich nicht. Wenn zum Beispiel bei einer VGA-Kamera mit einer Auflösung von 640 x 480 Bildpunkten das eigentliche Objekt nur 480 x 480 Bildpunkte abdeckt, dann kann dieser Bereich als Area-of-Interest gesetzt werden, um keine Bandbreite zu vergeuden. Bitte beachten Sie, dass sich die AOI-Möglichkeiten von CCD- und CMOS-Sensoren stark unterscheiden. Weitere Informationen über die Nyquist-Frequenz finden Sie in Bildgebungselektronik 101: Kamera-Varianten und Schnittstellen für die industrielle Bildverarbeitung.

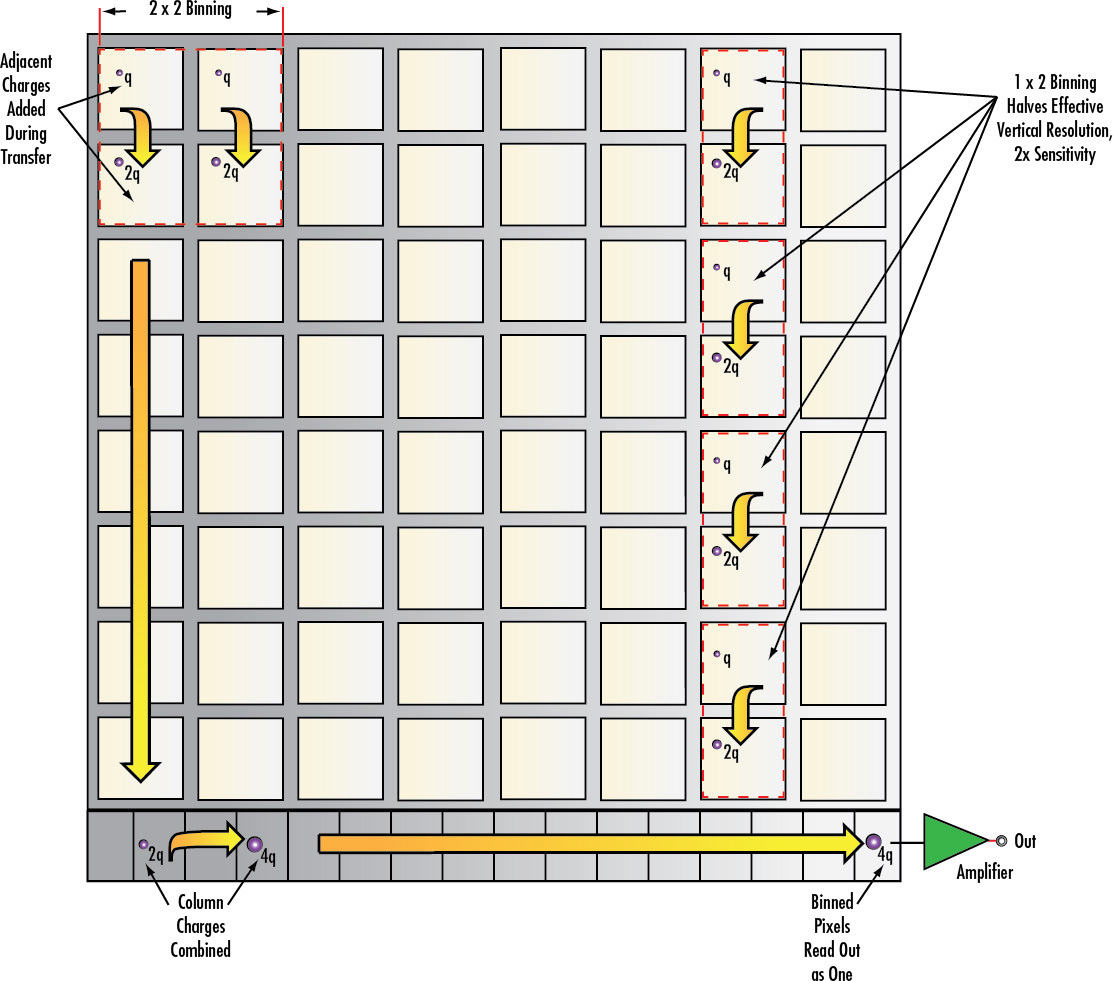

BINNING/SUBSAMPLING

Beim Binning und Subsampling wird das gesamte Bildfeld benötigt, nicht jedoch die volle Kamera auflösung. In diesem Fall können entweder die Grauwerte benachbarter Pixel zu einem Mittelwert zusammengefasst werden, welche dann größere effektive Pixel bilden, oder es wird nur jedes zweite Pixel ausgelesen. Durch "Binning" bzw. "Subsampling" erhöht sich die Geschwindigkeit, weil weniger Daten übertragen werden müssen.

"Binning" ist eine spezifische Funktion für CCD-Sensoren. Dabei wird die Ladung benachbarter Pixel addiert, sodass sich die effektive Belichtung und Empfindlichkeit erhöhen. "Subsampling" bezieht sich allgemein auf CMOS-Sensoren, bei denen "Binning" nicht wirklich möglich ist; "Subsampling" erhöht weder die Empfindlichkeit noch verstärkt es die Belichtung. "Subsampling" kann bei CCD-Sensoren auch statt "Binning" eingesetzt werden, wenn eine niedrige Auflösung zulässig und eine hohe Bildwiederholfrequenz notwendig ist und die volle Lichtstärke nicht benötigt wird. Umfassende Informationen zu den unterschiedlichen Sensoren finden Sie in Bildgebungselektronik 101: Kamerasensoren für die industrielle Bildverarbeitung.

Abb.5: Binning bzw. Subsampling von Kamerapixeln

PIXELTAKT

In einem CCD-Kamerasensor gibt der Pixeltakt die Frequenz der komplementären Signale an, welche die Ladungspakete durch die Sensorzeilen, bzw. Schieberegister, zu den Ausleseverstärkern bewegen. Dieser Wert bestimmt, wie lange es dauert, den gesamten Sensor auszulesen und wird begrenzt vom Rauschen und Überlaufeffekten, die auftreten, wenn die Datenpakete zu schnell übertragen werden. Wenn beispielsweise zwei Kameras mit identischen Sensoren verschiedene Pixeltaktraten verwenden, können sich die Sättigungskapazität (linearer Bereich) und die Bildraten unterscheiden. Diese Einstellung kann vom Benutzer nicht ohne weiteres geändert werden, da sie in der Regel auf einen sensor- und FPGA-spezifischen Optimalwert eingestellt ist. Eine Übertaktung des Sensors durch eine Erhöhung der Pixeltaktrate kann zudem zu Wärmeproblemen führen.

OFFSET

"Offset" bezieht sich auf den Gleichspannungsanteil eines Video- oder Bildsignals und definiert im Prinzip den Schwarzwert des Bildes. Der Schwarzwert ist die Pixelspannung (in Elektronen oder Volt), die einem Pixelwert null entspricht. Dieser Wert wird oft zusammen mit einem Histogramm eingesetzt, um die volle Pixeltiefe der Kamera zu nutzen und so das Signal-Rauch-Verhältnis effektiv zu erhöhen. Werden nicht-schwarze Pixel auf null gesetzt, wird das Bild heller, allerdings kommt es nicht zu einer Verbesserung der Daten. Durch Erhöhung des Schwarzwerts lässt sich der Offset als einfaches Verarbeitungsverfahren für die industrielle Bildverarbeitung einsetzen, um das Bild aufzuhellen und effektiv einen Schwellenwert festzulegen, da alle Pixel unter einem bestimmten Wert auf null gesetzt werden, um Details zu erkennen.

TRIGGERAUSLÖSUNG

Je nach der Anwendung kann es nützlich sein, den Sensor nur dann zu belichten oder zu aktivieren, wenn dies von Interesse ist. Wenn die Kamera nur nach einem bestimmten Auslösesignal Bilder aufnimmt, so spricht man vom "Trigger". Damit kann die Kamera zum Beispiel mit einer geblitzten Lichtquelle synchronisiert werden oder genau dann ausgelöst werden, wenn das aufzunehmende Objekt einen bestimmten Punkt passiert oder einen Annäherungsschalter aktiviert. Letzteres ist nützlich, wenn Bilder zur späteren Prüfung gespeichert werden sollen. Trigger können auch eingesetzt werden, wenn der Benutzer eine Bildsequenz in unregelmäßigen Abständen aufnehmen muss, statt mit einer konstanten Einzelbildfrequenz.

Die Triggerauslösung kann über ein externes Signal oder die Software erfolgen. Externe Triggersignale eignen sich ideal für Präzisionsanwendungen, wenn die für Softwaretrigger typische Latenz, die mehrere Millisekunden betragen kann, bereits zu viel ist. Software-Trigger lassen sich oft einfacher implementieren, weil sie nicht mehr sind als ein Computerbefehl, der auf dem normalen Übertragungsweg gesendet wird. Ein Beispiel für einen Softwaretrigger ist die Schnappschussfunktion der Bildsoftware.

Es gibt noch viele weitere Digitalkameraeinstellungen, wichtig ist jedoch das Verständnis der grundlegenden Parameter Gain, Gamma (Mitten), Bildfeld, Binning/Subsampling, Pixeltakt, Offset und Trigger. Diese Funktionen sind die Grundlage für fortgeschrittene Bildverarbeitungsverfahren. Weitere Informationen über Bildgebungselektronik finden Sie in unserer zusätzlichen Serie zur Bildgebungselektronik 101 über Kamerasensoren, Kameraauflösung, and Kamerabauformen.

weitere regionale Telefonnummern

ANGEBOTSTOOL

Geben Sie zum Starten die Produktnummer ein.

Copyright 2023 | Edmund Optics, Ltd Unit 1, Opus Avenue, Nether Poppleton, York, YO26 6BL, UK

DATENSCHUTZRICHTLINIE | COOKIE POLICY | AGB | AGB FÜR B2C | IMPRESSUM | BARRIEREFREIHEIT

Die Edmund Optics GmbH Deutschland fungiert als Handelsvermittler für die Edmund Optics BV in den Niederlanden.

Vertragspartner ist Edmund Optics BV in den Niederlanden.

This content may include material that has been generated or modified using artificial intelligence (AI).

The FUTURE Depends On Optics®